Бинокулярный радар помог беспилотному автомобилю четко видеть сквозь туман

Кшниц Бансаль (Kshitiz Bansal) из Калифорнийского университета в Сан-диего и его коллеги разработали систему Pointillism, которая позволяет строить точное радарное изображение окружающих автомобилей.

Современные беспилотные автомобили следят за дорогой с помощью видеокамер, лидаров и радаров. Лидар позволяет точно определять расстояние до объектов или даже строить точные рельефные карты пространства, но дымка, туман и пыль создают существенные помехи, поскольку эффективная работа сенсора напрямую зависит от прозрачности окружающей среды. Кроме лидара от плохой погоды также страдают и камеры. Радару туман не помеха, но информация с него позволяет построить изображение лишь приблизительно, оно отображает только нечеткие силуэты, состоящие из небольшого набора точек.

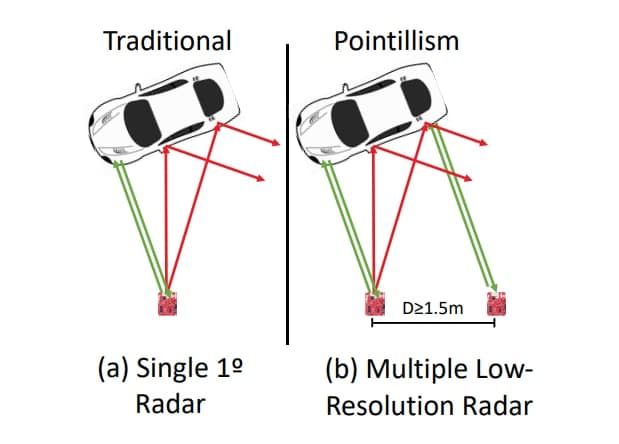

Основной принцип Pointillism — использование нескольких разнесенных радаров, которые облучают цель под разными углами, что серьезно увеличивает шанс на возвращение сигнала назад. Однако данные радаров недостаточно просто сложить. В чистом виде их данные представляют собой набор опорных точек отраженного сигнала, по которым затем предстоит построить компьютерную модель автомобиля. Но помимо точек от реальных объектов приемник фиксирует множество шумов, например от многократно отраженного эха, и потому суммирование данных просуммирует и шумы. Чтобы избавиться от них ученые разработали алгоритм перекрестного анализа данных. Поскольку в открытом доступе подходящей базы данных для обучения нет, ученые создали её самостоятельно, проезжая по реальным дорогам, и собрали так 54 тысячи пар радарных картинок и рамок. После тренировки Pointillism смог обнаруживать автомобили и определять их ориентацию при любых углах, даже при нулевой видимости из-за погодных условий. Скорость работы системы зависит от вычислительной мощности, и при использовании процессора NVIDIA GTX 1080 Ti она составила 50 кадров в секунду, что, по мнению авторов, достаточно для езды на разрешенной на дорогах скорости.

Источник: N+1

Дата публикации: 26.11.2020

Первоисточник: SenSys ’20: Proceedings of the 18th Conference on Embedded Networked Sensor Systems